Um relatório aponta que erros no ChatGPT liberou conversas vazadas com informações confidenciais para outros usuários

Porto Velho, RO - Um relatório preocupante informou que o ChatGPT é responsável por divulgar conversas vazadas com usuários, revelando até mesmo informações confidenciais, como logins e senhas, em alguns casos. Foi o que informou o ArsTechnica na segunda-feira (29).

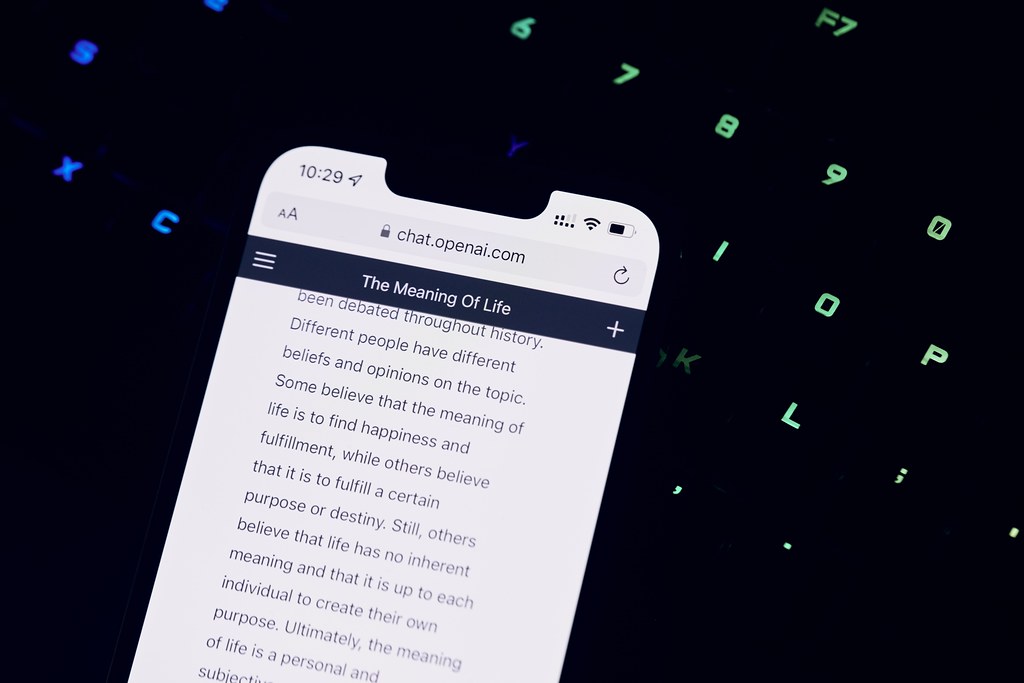

Capturas de tela compartilhadas com a publicação mostram a inteligência artificial (IA) generativa exibindo essas informações durante interações não relacionadas.

Em uma das capturas, são visíveis nomes de usuário e senhas de um sistema de suporte utilizado por funcionários de um portal de medicamentos prescritos por uma farmácia.

Ao que parece, um contratado da empresa interagiu com o chatbot da OpenAI em busca de soluções para algum problema na página, conforme relatado.

Outras conversas vazadas pelo ChatGPT revelaram detalhes de uma proposta de pesquisa não publicada, scripts em PHP e o nome de uma apresentação em desenvolvimento. As interações parecem ter sido realizadas por diferentes pessoas, de acordo com o relatório.

É importante destacar que a IA generativa já enfrentou vazamentos anteriores, expondo dados de assinantes e conversas para terceiros em março de 2023, além de informações utilizadas em seu treinamento em novembro do ano passado. A OpenAI afirmou que está investigando o incidente relatado agora e planeja fornecer detalhes em breve.

Quem acessou esses dados?

As senhas vazadas pelo ChatGPT surgiram inesperadamente para o usuário da plataforma, Chase Whiteside.

Ele relatou que solicitou ajuda à IA para encontrar nomes criativos para cores em uma paleta no domingo (28) e, em seguida, a tecnologia exibiu conversas com terceiros.

O usuário relatou que elas não estavam presentes quando usou o ChatGPT na noite anterior. Sendo um usuário frequente, ele reparou que existiam consultas inéditas que não partiram da sua conta.

No entanto, quando logou, elas simplesmente estavam no histórico, e continham conversas vazadas que não pertenciam a ele.

Com a recorrência desse problema, é crucial ter cautela com os dados compartilhados com o bot alimentado por IA. Especialistas recomendam evitar inserir informações sensíveis durante as interações com a tecnologia.

Como se prevenir de ter conversas vazadas?

Esse caso não isolado de conversas vazadas do ChatGPT pode ser apenas um erro interno, um problema no servidor ou um atalho errado. Seja como for, prejudicou a confidencialidade do usuário em questão, informando dados sigilosos.

Por isso, é recomendável tomar algumas atitudes ao usar essa ferramenta de IA. Mesmo ela sendo útil para diversas atividades, vale a pena tomar precauções ao usar para fins de trabalho.

Inicialmente, evite associar o e-mail da empresa ou endereços corporativos na hora de montar os scripts. Uma vez que eles ficam salvos no histórico do usuário em login, existe a chance de comprometer também o perfil.

Além disso, evite usar nomes reais ou informações confidenciais em consultas ao ChatGPT. Muitas pessoas utilizam para buscar ideias criativas ou problemas de lógica, por exemplo.

Nesse caso, use nomes fictícios e diminua a quantidade de detalhes que permita identificar a empresa em questão. O mesmo vale para informações pessoais, como recomendações de senhas ou descrições de perfis.

Apesar de ser um recurso disponível, também evite upar documentos e planilhas com dados que não deveriam ser compartilhados fora do escopo corporativo.

Códigos, números e finanças são informações protegidas pelas normas da empresa, e problemas como esse, das conversas vazadas, colocam em xeque uma série de dados pilares das empresas.

Adotar essas medidas de cuidado e outras práticas de segurança online evitam problemas com a visualização não autorizada de determinados chats. Ainda, vale reforçar a senha de login e limpar o histórico periodicamente, especialmente se já resolveu o problema e não precisará mais daquelas orientações.

0 Comentários